KI Bundesliga Wett Tipps statistisch fundiert: Zahlen, die wirklich zählen

Sportvorhersagen

Ladevorgang...

Ladevorgang...

Die Welt der KI-gestützten Bundesliga-Prognosen ist voller Zahlen. Tabellen, Prozente, Wahrscheinlichkeiten, erwartete Tore und dutzende weitere Metriken prasseln auf den interessierten Sportwetter ein. Doch welche dieser Zahlen haben tatsächlich prädiktive Kraft? Welche Statistiken nutzen KI-Systeme wirklich, um verlässliche Vorhersagen zu treffen, und welche sind bloßer Datenmüll, der zwar beeindruckend aussieht, aber wenig zur Prognosequalität beiträgt?

Diese Fragen sind keineswegs akademischer Natur. Wer KI-Tipps verstehen und sinnvoll nutzen möchte, muss die statistischen Grundlagen kennen, auf denen sie basieren. Nur so lässt sich einschätzen, wann eine Prognose auf solidem Fundament steht und wann sie auf statistischem Treibsand gebaut ist. Dieser Artikel taucht tief in die Welt der Wettstatistik ein und erklärt in verständlicher Sprache, welche Zahlen zählen und welche man getrost ignorieren kann.

Die gute Nachricht: Man muss kein Mathematiker sein, um die wichtigsten Konzepte zu verstehen. Die schlechte Nachricht: Viele populäre Statistiken, die in Fußballübertragungen und auf Wettportalen präsentiert werden, sind für Prognosen weitgehend nutzlos. Die Erkenntnis, dass mehr Information nicht automatisch bessere Entscheidungen bedeutet, ist vielleicht die wichtigste Lektion für jeden datenorientierten Sportwetter.

Grundlagen der Wettstatistik verstehen

Bevor wir in spezifische Fußballstatistiken eintauchen, lohnt sich ein Blick auf die fundamentalen Konzepte, die jeder KI-gestützten Prognose zugrunde liegen. Diese Grundlagen sind nicht kompliziert, aber ihr Verständnis ist essentiell für die kritische Bewertung jeglicher KI-Tipps.

Der erste und wichtigste Begriff ist die Wahrscheinlichkeit. Eine KI, die einen Bayern-Sieg mit 65 Prozent Wahrscheinlichkeit vorhersagt, macht damit keine deterministische Aussage. Sie sagt nicht, dass Bayern gewinnen wird. Sie sagt, dass in einer hypothetischen Welt, in der dieses Spiel hundertmal unter identischen Bedingungen stattfände, Bayern etwa 65 Mal gewinnen würde. Das klingt banal, hat aber tiefgreifende Konsequenzen. Selbst eine perfekte KI mit perfekten Prognosen würde in diesem Beispiel in 35 von 100 Fällen daneben liegen. Varianz ist kein Fehler des Systems, sondern die Natur des Spiels.

Eng damit verbunden ist das Konzept des erwarteten Werts. Eine Wette lohnt sich langfristig nur dann, wenn ihr erwarteter Wert positiv ist. Wenn eine KI einem Ereignis 65 Prozent Wahrscheinlichkeit zuweist und der Buchmacher eine Quote von 1,70 anbietet, was einer impliziten Wahrscheinlichkeit von etwa 59 Prozent entspricht, dann hat diese Wette einen positiven erwarteten Wert. Die Differenz zwischen geschätzter Wahrscheinlichkeit und Quote-implizierter Wahrscheinlichkeit ist der potentielle Gewinn, den KI-Systeme systematisch zu identifizieren versuchen.

Konfidenzintervalle sind ein weiteres Schlüsselkonzept. Wenn eine KI sagt, dass Dortmund mit 45 Prozent Wahrscheinlichkeit gewinnt, sagt sie eigentlich: Basierend auf den verfügbaren Daten liegt die wahre Siegwahrscheinlichkeit wahrscheinlich irgendwo zwischen 38 und 52 Prozent, und 45 Prozent ist der beste Punktschätzer. Je mehr relevante Daten zur Verfügung stehen, desto enger wird dieses Intervall, desto sicherer die Prognose. Bei einem Spiel zwischen zwei Mittelfeld-Teams mit langer gemeinsamer Historie in der Bundesliga sind die Konfidenzintervalle typischerweise enger als bei einem Spiel mit einem frisch aufgestiegenen Team, über das weniger Daten existieren.

Die Stichprobengröße ist dabei von entscheidender Bedeutung. Fünf Spiele sind statistisch gesehen fast bedeutungslos. Zehn Spiele erlauben erste vorsichtige Schlüsse. Dreißig Spiele beginnen, ein verlässlicheres Bild zu zeichnen. Hundert Spiele ermöglichen robuste Aussagen. Das Problem: Eine Bundesliga-Saison hat nur 34 Spieltage. Ein Team spielt maximal 17 Heim- und 17 Auswärtsspiele. Für viele Analysen, etwa die Leistung eines Teams gegen Top-Gegner zu Hause, stehen pro Saison vielleicht nur drei oder vier relevante Spiele zur Verfügung. KI-Systeme begegnen diesem Problem, indem sie historische Daten über mehrere Saisons aggregieren, aber auch das hat Grenzen, denn Teams verändern sich ständig durch Transfers, Trainerwechsel und natürliche Leistungsschwankungen.

Statistiken mit echter Vorhersagekraft

Nicht alle Zahlen sind gleich geschaffen. Die moderne Fußballanalyse hat in den letzten Jahren erhebliche Fortschritte bei der Identifikation von Statistiken gemacht, die tatsächlich zukünftige Leistungen vorhersagen können. Diese Erkenntnisse bilden das Fundament seriöser KI-Prognosen für die Bundesliga.

Expected Goals, kurz xG, ist die mit Abstand wichtigste Metrik für KI-gestützte Wettprognosen. Der Grund ist einfach: xG misst die Qualität der Torchancen, nicht bloß deren Ergebnis. Ein Team, das über mehrere Spiele einen xG-Wert von 2,0 pro Spiel erzielt, aber nur 1,0 Tore schießt, unterperformt seine Chancen. Die statistische Wahrscheinlichkeit, dass diese Diskrepanz dauerhaft anhält, ist gering. Umgekehrt gilt: Ein Team mit einem xG von 1,0, das aber regelmäßig zwei Tore pro Spiel erzielt, überperformt und wird wahrscheinlich zum Mittelwert zurückkehren. KI-Systeme nutzen diese Regressionseffekte, um Value Bets zu identifizieren, bei denen Buchmacher aktuelle Ergebnisse überbewerten und zugrunde liegende Leistungsfähigkeit unterschätzen.

Schüsse auf Tor haben ebenfalls prädiktive Kraft, allerdings weniger als xG, da sie die Qualität der Chancen nicht berücksichtigen. Ein Team kann zehn Schüsse auf das Tor abfeuern, aber wenn alle aus 25 Metern kommen, sagt das wenig über seine tatsächliche Torgefährlichkeit aus. Dennoch ist die Anzahl der Schüsse auf Tor stabiler als die der tatsächlich erzielten Tore und kann als ergänzender Indikator dienen, besonders wenn detaillierte xG-Daten nicht verfügbar sind.

Pressing-Intensität, oft gemessen als PPDA (Pässe des Gegners pro Defensivaktion), ist ein relativ neuer Favorit unter analytisch orientierten Wettern. Teams mit niedrigem PPDA-Wert pressen aggressiv und lassen dem Gegner wenig Zeit am Ball. Diese Statistik ist bemerkenswert stabil über die Saison und korreliert mit Erfolg, besonders in der physisch anspruchsvollen Bundesliga. Ein Team, das plötzlich deutlich weniger presst als gewöhnlich, könnte auf physische Ermüdung hindeuten, was für Prognosen bei englischen Wochen relevant ist.

Chancenqualität der Gegner, also der xGA-Wert (expected Goals Against), ist für die Vorhersage von Gegentreffern wichtiger als die tatsächlich kassierten Tore. Ein Team mit niedrigem xGA hat eine solide Defensive und limitiert den Gegner auf schlechte Chancen. Selbst wenn es durch unglückliche Umstände mehr Gegentreffer kassiert hat als der xGA-Wert vermuten ließe, ist zu erwarten, dass sich dies langfristig ausgleicht.

Regression zum Mittelwert im Fußball

Das vielleicht am häufigsten missverstandene Konzept in der Sportwettenanalyse ist die Regression zum Mittelwert. Der Begriff klingt technisch, beschreibt aber ein fundamentales Prinzip: Extreme Ergebnisse tendieren dazu, sich bei Wiederholung dem Durchschnitt anzunähern.

Im Fußballkontext bedeutet das: Ein Team, das in den ersten fünf Saisonspielen fünf Siege eingefahren hat, wird wahrscheinlich nicht die gesamte Saison mit einer Siegquote von 100 Prozent beenden. Umgekehrt wird ein Team, das fünfmal in Folge verloren hat, statistisch gesehen nicht jedes weitere Spiel verlieren. Das mag offensichtlich klingen, aber Buchmacher und Wetter übersehen dieses Prinzip regelmäßig. Sie schließen von einer Handvoll Ergebnissen auf die wahre Stärke eines Teams und überbewerten dabei kurzfristige Formkurven.

KI-Systeme sind speziell darauf trainiert, Regression zum Mittelwert zu identifizieren und auszunutzen. Wenn ein Team mit einem xG-Wert von 1,8 und einem xGA-Wert von 1,2 in den letzten fünf Spielen nur einen Sieg errungen hat, weil es seine Chancen nicht nutzte und der Gegner überdurchschnittlich effizient war, erkennt eine gute KI die Diskrepanz zwischen Leistung und Ergebnis. Sie prognostiziert nicht auf Basis der mageren Ausbeute, sondern auf Basis der zugrunde liegenden Statistiken.

Allerdings hat Regression zum Mittelwert ihre Grenzen. Der entscheidende Punkt ist, welcher Mittelwert gemeint ist. Ein Aufsteiger, der in den ersten Spielen überrascht, regrediert zu seinem Aufsteiger-Mittelwert, nicht zum Liga-Mittelwert. Ein alterndes Team mit vielen Abgängen im Sommer regrediert möglicherweise zu einem neuen, niedrigeren Mittelwert. KI-Systeme müssen diese sich verändernden Baselines berücksichtigen, was sie vor erhebliche Herausforderungen stellt. Die Annahme, dass ein Team immer zu seiner historischen Durchschnittsleistung zurückkehrt, ist genauso falsch wie die Annahme, dass aktuelle Ergebnisse die zukünftige Leistung perfekt vorhersagen.

Besonders relevant ist Regression zum Mittelwert bei extremen Torhüterleistungen. Ein Torhüter mit einer Fangquote von 85 Prozent über zehn Spiele übertrifft wahrscheinlich sein wahres Niveau. Der Liga-Durchschnitt liegt bei etwa 70 Prozent, und selbst weltklasse Torhüter erreichen selten dauerhaft mehr als 75 Prozent. KI-Systeme, die Post-Shot-xG verwenden, können solche Überperformances identifizieren und in ihre Prognosen einbeziehen.

Stichprobengrößen richtig einschätzen

Die Frage, ab wann eine Stichprobe aussagekräftig ist, beschäftigt Statistiker seit Jahrhunderten. Im Kontext von Bundesliga-Prognosen ist sie besonders brisant, weil die verfügbaren Datenmengen oft überraschend klein sind.

Ein einzelnes Fußballspiel ist statistisch gesehen fast bedeutungslos. Ein Tor kann das Ergebnis eines brillanten Spielzugs sein oder eines grotesken Abwehrfehlers. Ein Elfmeter kann berechtigt oder eine Fehlentscheidung sein. Der Ball kann an den Pfosten gehen oder einen Zentimeter daneben ins Netz. All diese Zufälligkeiten summieren sich zu einer enormen Varianz. KI-Systeme, die aus einzelnen Spielen weitreichende Schlüsse ziehen, sind zum Scheitern verurteilt.

Bei zehn Spielen beginnt sich ein Muster abzuzeichnen, aber die Varianz bleibt hoch. Ein Team, das in zehn Spielen 25 Tore erzielt hat, könnte tatsächlich eine Tormaschine sein, aber es könnte auch einfach eine überdurchschnittliche Glückssträhne gehabt haben. Die statistischen Konfidenzintervalle bei zehn Spielen sind breit genug, um erhebliche Unsicherheit zu erlauben.

Dreißig Spiele, also fast eine komplette Bundesliga-Saison, erlauben robustere Aussagen. Hier beginnen sich zufällige Schwankungen auszugleichen, und die wahre Stärke eines Teams wird sichtbarer. Allerdings sind selbst 30 Spiele für manche Analysen zu wenig. Die Leistung eines Teams gegen die Top-Sechs-Gegner zu Hause basiert auf maximal drei Spielen pro Saison. Die Performance in Nachholspielen unter der Woche mag auf einem oder zwei Datenpunkten beruhen. Für solche Teilanalysen ist selbst eine komplette Saison statistisch dünn.

KI-Systeme begegnen diesem Dilemma auf verschiedene Weisen. Manche aggregieren Daten über mehrere Saisons, was die Stichprobe vergrößert, aber das Risiko birgt, veraltete Informationen einzubeziehen. Ein Team, das vor zwei Jahren stark war, ist heute möglicherweise ein Schatten seiner selbst. Andere Systeme verwenden hierarchische Modelle, die Informationen aus ähnlichen Situationen borgen. Wenn wenig Daten über einen bestimmten Aufsteiger vorliegen, können allgemeine Informationen über das Verhalten von Aufsteigern als Proxy dienen. Beide Ansätze sind Kompromisse, und keiner löst das grundsätzliche Problem der kleinen Stichproben vollständig.

Statistiken mit geringer Vorhersagekraft

Genauso wichtig wie das Wissen um aussagekräftige Statistiken ist das Verständnis dafür, welche Zahlen wenig zur Prognosequalität beitragen. Viele populäre Fußballstatistiken, die in Fernsehübertragungen und auf Wettportalen prominent präsentiert werden, sind für Wettzwecke weitgehend nutzlos.

Ballbesitz ist das prominenteste Beispiel für eine überbewertete Statistik. Die Annahme, dass mehr Ballbesitz zu mehr Siegen führt, ist intuitiv nachvollziehbar, aber empirisch schwach belegt. Tatsächlich korreliert Ballbesitz in der Bundesliga nur minimal mit dem Spielausgang. Ein Team kann 70 Prozent Ballbesitz haben und trotzdem verlieren, weil es den Ball vor dem gegnerischen Strafraum quer schiebt, ohne gefährliche Chancen zu kreieren. Umgekehrt können Teams mit wenig Ballbesitz durch schnelles Konterspiel hochgefährlich sein. Konter-orientierte Teams wie es etwa zeitweise Union Berlin oder Mainz praktizierten, widerlegen regelmäßig die naive Ballbesitz-Theorie.

Passquote und Gesamtzahl der Pässe sind ähnlich irreführend. Ein Team mit 90 Prozent Passquote ist nicht automatisch besser als eines mit 80 Prozent. Die Frage ist, welche Art von Pässen gespielt werden. Hundert erfolgreiche Querpässe in der eigenen Hälfte sind weniger wertvoll als zehn riskante Steilpässe in die Spitze, von denen fünf ankommen. KI-Systeme, die fortschrittliche Passstatistiken verwenden, etwa progressive Pässe oder Pässe ins letzte Drittel, erzielen bessere Ergebnisse als solche, die auf der rohen Passquote basieren.

Zweikampfquoten werden oft als Indikator für Einsatz und Kampfgeist herangezogen, haben aber wenig prädiktive Kraft. Ein Team, das viele Zweikämpfe gewinnt, kann trotzdem verlieren, wenn diese Zweikämpfe an ungefährlichen Stellen stattfinden oder wenn der Gegner Zweikämpfe durch geschickte Positionierung vermeidet. Zudem sind Zweikampfstatistiken notorisch inkonsistent in ihrer Definition und Erhebung.

Eckbälle und Einwürfe sind statistischer Lärm. Die Anzahl der Ecken korreliert kaum mit dem Spielausgang, und noch weniger mit der Anzahl der erzielten Tore. Ein Team kann zehn Ecken haben, ohne je ernsthaft gefährlich zu werden, während der Gegner mit einer einzigen Ecke trifft. Die Ecken-Märkte bei Buchmachern sind entsprechend schwer zu schlagen, selbst mit KI-Unterstützung.

Die wichtigsten Bundesliga-Statistiken für KI

Nach der Diskussion allgemeiner Prinzipien lohnt sich ein Blick auf die spezifischen Statistiken, die für KI-Prognosen in der Bundesliga besonders relevant sind. Die Bundesliga hat ihre Eigenheiten, die sich von anderen europäischen Ligen unterscheiden und die Auswahl relevanter Metriken beeinflussen.

Die Bundesliga ist traditionell eine der torreichsten Ligen Europas. Im Vergleich zu Serie A oder Ligue 1 fallen deutlich mehr Tore pro Spiel. Das hat Implikationen für die Gewichtung offensiver Statistiken. xG-Werte in der Bundesliga tendieren höher als in defensiver ausgerichteten Ligen, was bei ligaübergreifenden Vergleichen berücksichtigt werden muss. KI-Systeme, die mit absoluten Schwellenwerten arbeiten, etwa alle Teams mit xG über 1,5 als offensivstark zu klassifizieren, müssen diese Liga-spezifischen Unterschiede einkalkulieren.

Die Heimstärke ist in der Bundesliga ausgeprägter als in manchen anderen Ligen. Die Atmosphäre in deutschen Stadien, mit Stehplätzen und lautstarken Fankurven, scheint einen messbaren Einfluss auf die Leistung zu haben. KI-Systeme sollten Heim-Auswärts-Splits entsprechend gewichten und nicht davon ausgehen, dass ein Team zu Hause und auswärts gleich stark ist.

Trainertaktiken variieren in der Bundesliga stark, was detaillierte taktische Statistiken wertvoll macht. Von der Pressing-Maschine Leverkusen unter Xabi Alonso bis zu defensiver ausgerichteten Teams gibt es ein breites Spektrum an Spielphilosophien. Statistiken wie PPDA, Konter pro Spiel, oder Anteil langer Bälle helfen KI-Systemen, diese taktischen Unterschiede zu erfassen und in Prognosen einzubeziehen.

Die Belastung durch internationale Wettbewerbe ist relevant für Teams, die in Champions League oder Europa League spielen. Statistiken zur Rotation, Laufleistung in der Vorwoche, und Tage seit dem letzten Spiel können helfen, die physische Frische eines Teams einzuschätzen. Bayern, Dortmund und andere Europapokal-Teilnehmer zeigen oft signifikante Leistungsschwankungen in Abhängigkeit vom Spielkalender.

Statistik-Quellen für eigene Analysen

Wer KI-Tipps nicht blind vertrauen, sondern selbst nachprüfen möchte, benötigt Zugang zu verlässlichen Statistikquellen. Glücklicherweise ist die Datenverfügbarkeit im Fußball in den letzten Jahren explodiert, und viele hochwertige Ressourcen sind kostenlos zugänglich.

FBref, betrieben von Sports Reference, ist die umfassendste kostenlose Quelle für fortschrittliche Fußballstatistiken. Die Seite bietet xG-Daten von StatsBomb, detaillierte Schussstatistiken, Passing-Analysen und vieles mehr. Die Bundesliga-Daten sind vollständig abgedeckt, und die historische Tiefe reicht mehrere Jahre zurück. Für den durchschnittlichen Sportwetter, der seine eigenen Analysen durchführen oder KI-Tipps validieren möchte, ist FBref die erste Anlaufstelle.

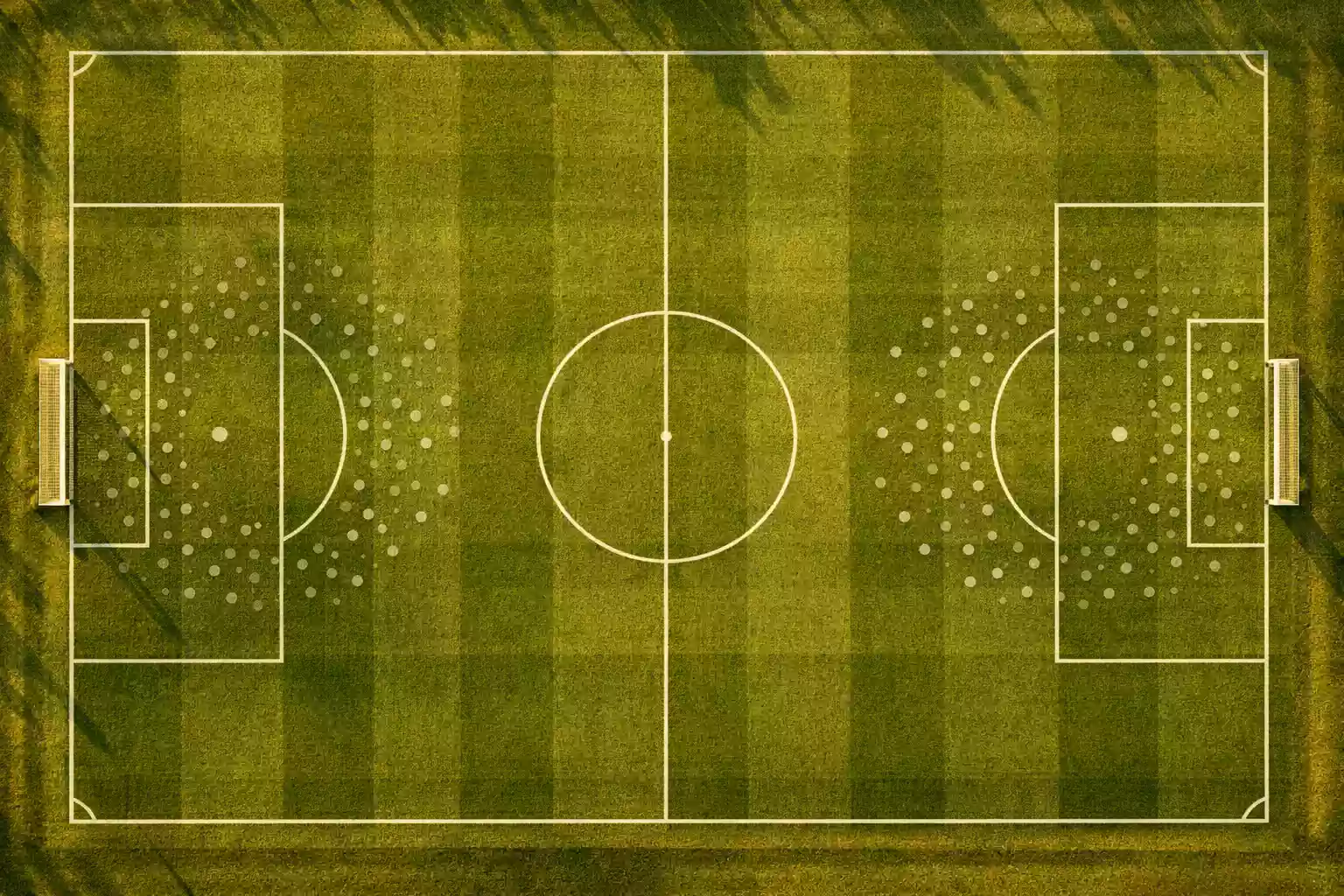

Understat spezialisiert sich auf xG-Analysen und bietet interaktive Shot-Maps, die zeigen, wo auf dem Feld Schüsse abgegeben wurden. Die Visualisierungen helfen, ein intuitives Verständnis für die Chancenqualität eines Teams zu entwickeln. Understat deckt die Top-Ligen ab, einschließlich der Bundesliga, und bietet sowohl Team- als auch Spieler-bezogene Statistiken.

Transfermarkt ist für Kaderdaten unübertroffen. Marktwerte, Vertragslaufzeiten, Verletzungshistorien und detaillierte Transferinformationen sind hier verfügbar. Für KI-Analysen, die Kaderqualität und Verletzungen berücksichtigen, ist Transfermarkt eine unverzichtbare Ressource. Die Seite ist besonders wertvoll für die Bundesliga, da sie ihren Ursprung in Deutschland hat und entsprechend detaillierte Daten für die Liga bietet.

Die offizielle Bundesliga-Website und App bieten in Zusammenarbeit mit AWS zunehmend fortschrittliche Statistiken. Tracking-Daten, Laufleistung, und erweiterte Performance-Metriken sind hier verfügbar, auch wenn die analytische Tiefe nicht ganz an spezialisierte Plattformen heranreicht. Für Casual-Analysen und einen schnellen Überblick ist die offizielle Quelle aber durchaus brauchbar.

Häufige statistische Irrtümer vermeiden

Der statistische Analphabetismus ist weit verbreitet, und auch viele KI-Tipps basieren auf fehlerhaften statistischen Schlussfolgerungen. Das Erkennen dieser Irrtümer hilft, schlechte von guten Prognosen zu unterscheiden.

Der Gambler's Fallacy, also der Spielerirrtum, ist der Glaube, dass vergangene Ergebnisse zukünftige unabhängige Ereignisse beeinflussen. Wenn Bayern dreimal in Folge unentschieden gespielt hat, bedeutet das nicht, dass ein Sieg überfällig ist. Jedes Spiel ist ein neues, unabhängiges Ereignis. Natürlich gibt es Regression zum Mittelwert, aber diese operiert auf der Ebene zugrunde liegender Wahrscheinlichkeiten, nicht auf der Ebene einzelner Ergebnisse.

Survivorship Bias verzerrt die Wahrnehmung von Wettstrategien und KI-Systemen. Wenn ein Wettportal stolz seine erfolgreichen KI-Tipps präsentiert, aber die Misserfolge verschweigt, entsteht ein verzerrtes Bild der tatsächlichen Leistungsfähigkeit. Seriöse Anbieter dokumentieren alle Tipps, nicht nur die gewonnenen. Wer bei der Auswahl von KI-Tipps auf Survivorship Bias hereinfällt, überschätzt systematisch deren Zuverlässigkeit.

Das Gesetz der kleinen Zahlen beschreibt die Tendenz, aus wenigen Beobachtungen weitreichende Schlüsse zu ziehen. Wenn ein Spieler in drei Spielen dreimal getroffen hat, ist er kein Torgarant. Wenn ein Team zweimal gegen Top-Teams gewonnen hat, ist es nicht automatisch ein Geheimfavorit. KI-Systeme, die auf robusten statistischen Methoden basieren, berücksichtigen die Unsicherheit, die mit kleinen Stichproben einhergeht. Systeme, die aus Einzelereignissen vermeintliche Muster ableiten, sind mit Vorsicht zu genießen.

Korrelation und Kausalität werden häufig verwechselt. Wenn Teams mit roten Trikots statistisch häufiger gewinnen, bedeutet das nicht, dass rote Trikots Siege verursachen. Möglicherweise haben zufällig starke Teams rote Trikots, oder die Korrelation ist reiner Zufall. KI-Systeme, die bloße Korrelationen als Prognose-Inputs verwenden, ohne den kausalen Mechanismus zu verstehen, sind anfällig für solche Scheinzusammenhänge. Die Frage warum eine Statistik prädiktiv sein sollte ist genauso wichtig wie die Beobachtung, dass sie es empirisch ist.

Overfitting ist ein speziell für KI relevantes Problem. Ein Modell, das zu genau auf historische Daten zugeschnitten ist, wird neue Daten schlecht vorhersagen. Stellen Sie sich eine KI vor, die gelernt hat, dass Bayern immer gegen Paderborn zu Hause gewinnt, basierend auf fünf historischen Spielen. Diese Regel ist zu spezifisch. Wenn sich Bayern oder Paderborn verändert, bricht die Regel zusammen. Gute KI-Systeme verwenden Regularisierungstechniken, um Overfitting zu vermeiden, aber nicht alle Anbieter investieren in diese statistische Sorgfalt.

Statistische Interpretation von KI-Tipps

Mit dem Wissen um statistische Grundlagen und häufige Irrtümer können wir nun zur praktischen Frage übergehen: Wie interpretiert man KI-Tipps statistisch korrekt?

Zunächst ist die Wahrscheinlichkeitsangabe wichtiger als die bloße Empfehlung. Wenn eine KI Bayern zum Siegen empfiehlt, sagt das wenig. Wenn sie Bayern mit 72 Prozent Siegwahrscheinlichkeit sieht, ist das eine konkrete, überprüfbare Aussage. Diese Wahrscheinlichkeit kann mit der Buchmacher-Quote verglichen werden, um zu prüfen, ob Value vorhanden ist. Eine Quote von 1,35 impliziert etwa 74 Prozent Wahrscheinlichkeit. Wenn die KI bei 72 Prozent liegt, gibt es keinen Value, selbst wenn Bayern wahrscheinlich gewinnt.

Die historische Kalibrierung einer KI ist entscheidend. Eine gut kalibrierte KI sollte Ereignisse, denen sie 70 Prozent Wahrscheinlichkeit zuweist, in etwa 70 Prozent der Fälle korrekt vorhersagen. Nicht 80 Prozent, nicht 60 Prozent, sondern 70 Prozent. Wettportale, die ihre Kalibrierungsdaten veröffentlichen, verdienen mehr Vertrauen als solche, die bloß Trefferquoten angeben. Eine Trefferquote von 55 Prozent ist bedeutungslos ohne Information über die zugewiesenen Wahrscheinlichkeiten.

Die Varianz von KI-Tipps sollte realistisch eingeschätzt werden. Selbst eine exzellente KI mit 60 Prozent erwarteter Trefferquote kann in einer Serie von zwanzig Tipps zehnmal oder weniger richtig liegen, einfach durch Pech. Varianz ist kein Zeichen für eine schlechte KI, sondern eine mathematische Notwendigkeit. Erst über hunderte von Tipps lässt sich beurteilen, ob eine KI systematisch besser ist als die Buchmacher oder nicht.

Die Sensitivität gegenüber Input-Veränderungen ist ebenfalls relevant. Wenn eine KI ihre Prognose stark ändert, weil ein Ergänzungsspieler verletzt ausfällt, sollte man skeptisch sein. Robuste Modelle sind gegenüber kleinen Input-Änderungen relativ stabil. Wenn eine Prognose von 60 auf 45 Prozent fällt, weil der dritte Torwart nicht dabei ist, stimmt etwas mit der statistischen Gewichtung nicht.

Die Zukunft statistischer KI-Prognosen

Die statistische Analyse im Fußball entwickelt sich rasant weiter. Neue Metriken und Methoden entstehen, die für KI-Prognosen zunehmend relevant werden. Ein Ausblick auf kommende Entwicklungen hilft, die zukünftige Landschaft der KI-gestützten Sportwetten einzuschätzen.

Tracking-Daten revolutionieren die Fußballanalyse. Anstatt nur Ereignisse wie Schüsse und Pässe zu erfassen, verfolgen moderne Systeme die Position jedes Spielers und des Balls mehrmals pro Sekunde. Aus diesen Daten lassen sich fortschrittliche Metriken berechnen, etwa die Raumkontrolle, die erwartete Bedrohung durch Läufe ohne Ball, oder die Defensiv-Positionierung. KI-Systeme, die Tracking-Daten nutzen, haben einen erheblichen Informationsvorsprung gegenüber solchen, die nur auf Event-Daten basieren.

Expected Threat und Expected Possession Value sind Beispiele für neue Metriken, die über xG hinausgehen. Anstatt nur den finalen Schuss zu bewerten, analysieren diese Modelle den gesamten Angriff und weisen jedem Ballkontakt einen Wert zu. Ein Pass, der einen Spieler in eine gefährliche Position bringt, wird gewürdigt, auch wenn am Ende kein Schuss folgt. Für KI-Prognosen sind diese ganzheitlicheren Bewertungen potenziell aussagekräftiger als xG allein.

Machine Learning selbst wird sophistizierter. Ensemble-Methoden, die verschiedene Modelle kombinieren, erzielen oft bessere Ergebnisse als einzelne Modelle. Bayesianische Ansätze erlauben eine systematischere Einbeziehung von Unsicherheit. Transfer Learning ermöglicht es, Erkenntnisse aus datenreichen Ligen auf Ligen mit weniger Daten zu übertragen. Die KI-Systeme der Zukunft werden von diesen methodischen Fortschritten profitieren.

Gleichzeitig bleiben fundamentale Grenzen bestehen. Fußball enthält echten Zufall, der durch keine noch so ausgeklügelte Analyse eliminiert werden kann. Ein Ball, der vom Pfosten ins Tor oder ins Aus springt, ist nicht vorhersagbar. Schiedsrichterentscheidungen, Verletzungen während des Spiels, oder momentane Konzentrationsschwächen einzelner Spieler sind statistisch nicht erfassbar. Die beste KI der Welt wird Fußball nie perfekt vorhersagen können, und jeder Anbieter, der anderes behauptet, ist unseriös.

Fazit: Statistisches Wissen als Wettbewerbsvorteil

Das Verständnis statistischer Grundlagen ist kein Luxus für den theoretisch interessierten Sportwetter, sondern ein praktischer Vorteil. Wer weiß, welche Zahlen aussagekräftig sind und welche nicht, kann KI-Tipps kritisch bewerten, Value erkennen, und schlechte Prognosen aussortieren.

Die wichtigsten Erkenntnisse lassen sich zusammenfassen: xG und verwandte Metriken sind für Prognosen wertvoll, Ballbesitz und Passquoten nicht. Regression zum Mittelwert ist real, aber der relevante Mittelwert muss korrekt identifiziert werden. Kleine Stichproben erlauben keine robusten Schlüsse. Korrelation ist keine Kausalität. Gute Kalibrierung ist wichtiger als hohe Trefferquoten.

Mit diesem Wissen ausgestattet, können Sportwetter die Flut an KI-Tipps navigieren und fundierte Entscheidungen treffen. Die Zahlen, die wirklich zählen, sind weniger und einfacher als die Datenflut vermuten lässt. Wer sie kennt und richtig interpretiert, hat einen Vorteil gegenüber denen, die von jeder präsentierten Statistik beeindruckt sind.